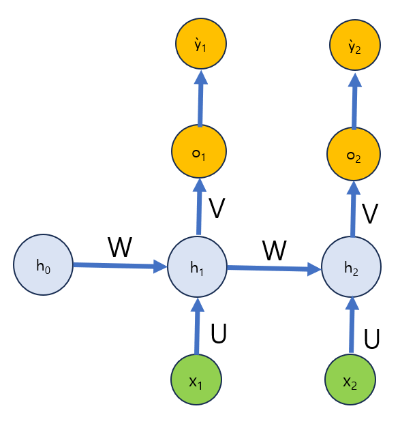

PixelRNN은 이미지 생성 모델로, 이미지의 픽셀을 순차적으로 예측하는 방식을 사용한다. 주로 자연스러운 이미지 생성을 목표로 하며, 각 픽셀의 값은 이전 픽셀들의 값에 의존하는 확률 모델을 기반으로 계산된다. PixelRNN은 픽셀 간의 의존성을 학습하여 점진적으로 이미지를 생성하는데, 이를 통해 더 세밀하고 자연스러운 이미지를 얻을 수 있다.arXiv:1601.06759주요 특징:순차적 예측: 이미지를 한 번에 생성하는 대신, PixelRNN은 픽셀을 하나씩 순차적으로 예측한다. 각 픽셀은 그 이전에 생성된 픽셀들에 의존하게 된다.RNN 구조: PixelRNN은 순환 신경망(RNN)을 사용하여 이미지의 각 픽셀을 생성한다. 각 픽셀은 행렬의 가로와 세로 방향에서 각각의 RNN 계층을 통해 계산되며..